貴州鮮水包裝及衍生品設計 融合地域特色與現代美學的美術圖案服務

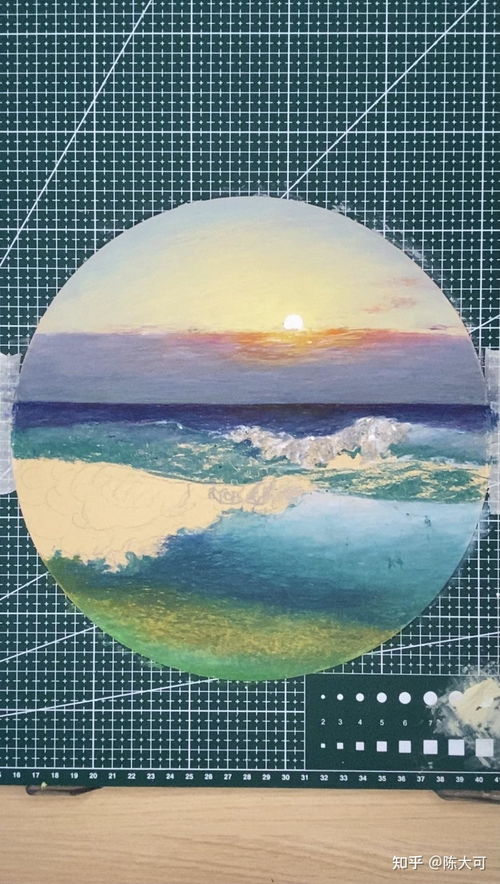

貴州鮮水作為地方特色飲品品牌,其包裝及衍生品設計不僅承擔產品保護功能,更是傳遞品牌文化與地域風情的重要媒介。我們提供專業的美術圖案設計服務,以貴州獨特的自然風光、民族元素與現代設計理念為核心,打造兼具視覺吸引力與文化內涵的包裝及衍生品。

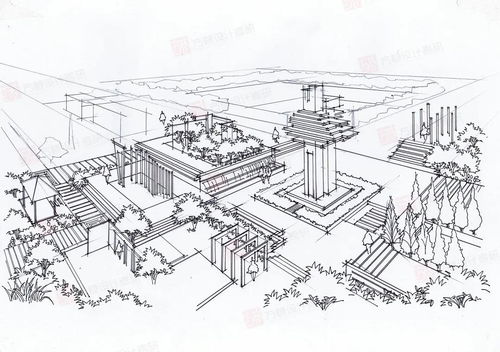

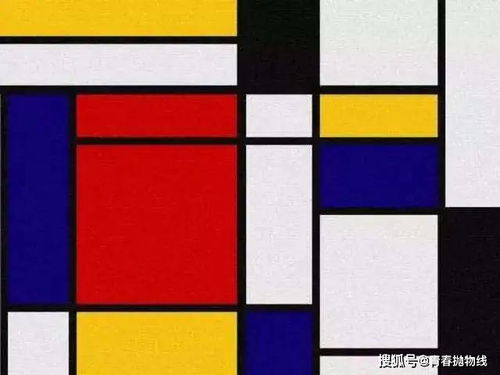

在設計過程中,我們深入挖掘貴州鮮水品牌的故事與定位,結合貴州豐富的非物質文化遺產——如苗族刺繡、侗族建筑圖騰、喀斯特地貌紋理等元素,運用現代插畫、字體設計和色彩搭配技巧,創作出系列化、可延展的美術圖案。這些圖案不僅應用于產品瓶身、禮盒包裝,還擴展至周邊衍生品,如杯具、環保袋、宣傳海報等,形成統一的品牌視覺系統。

我們的服務包括:前期調研與需求分析、概念草圖設計、圖案元素提煉、色彩方案制定、數字化精修及衍生品應用延展。通過精細化設計與多輪溝通,確保每一件作品都能精準傳達貴州鮮水的純凈、自然與民族特色,同時滿足市場審美與實用需求,助力品牌在競爭激烈的飲品市場中脫穎而出。

如若轉載,請注明出處:http://www.sp6z8.cn/product/38.html

更新時間:2026-06-01 22:30:34